Πίνακας Περιεχομένων

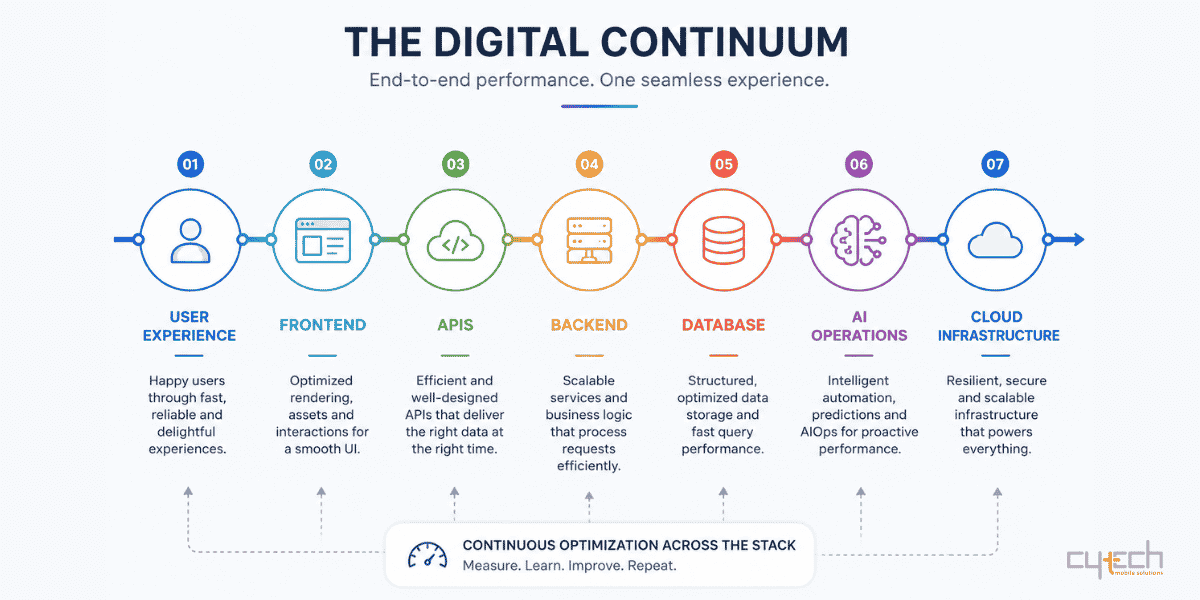

Η βελτιστοποίηση της απόδοσης ενός λογισμικού αποτελεί πλέον τόσο τεχνική όσο και στρατηγική προτεραιότητα. Η ανάπτυξη του επηρεάζει άμεσα τη λειτουργική σταθερότητα, την επεκτασιμότητα, το κόστος υποδομών και τη δυνατότητα καινοτομίας. Σε κατανεμημένες αρχιτεκτονικές, ακόμη και μικρές αναποτελεσματικότητες μπορούν να εξελιχθούν σε κρίσιμα προβλήματα κατά τη διάρκεια αυξημένης κίνησης. Παράλληλα, η χαμηλή απόδοση ενισχύει το τεχνικό χρέος, επιβραδύνει την ανάπτυξη και αυξάνει το κόστος συντήρησης. Για τον λόγο αυτό, οι σύγχρονοι οργανισμοί υιοθετούν ολοένα και περισσότερο μια κουλτούρα «systems thinking», όπου frontend, backend, APIs, βάσεις δεδομένων, caching και AI workflows βελτιστοποιούνται ως ένα ενιαίο και αλληλοσυνδεόμενο σύστημα.

Απόδοση Frontend: Σχεδιασμός με Επίκεντρο την Ανθρώπινη Αντίληψη

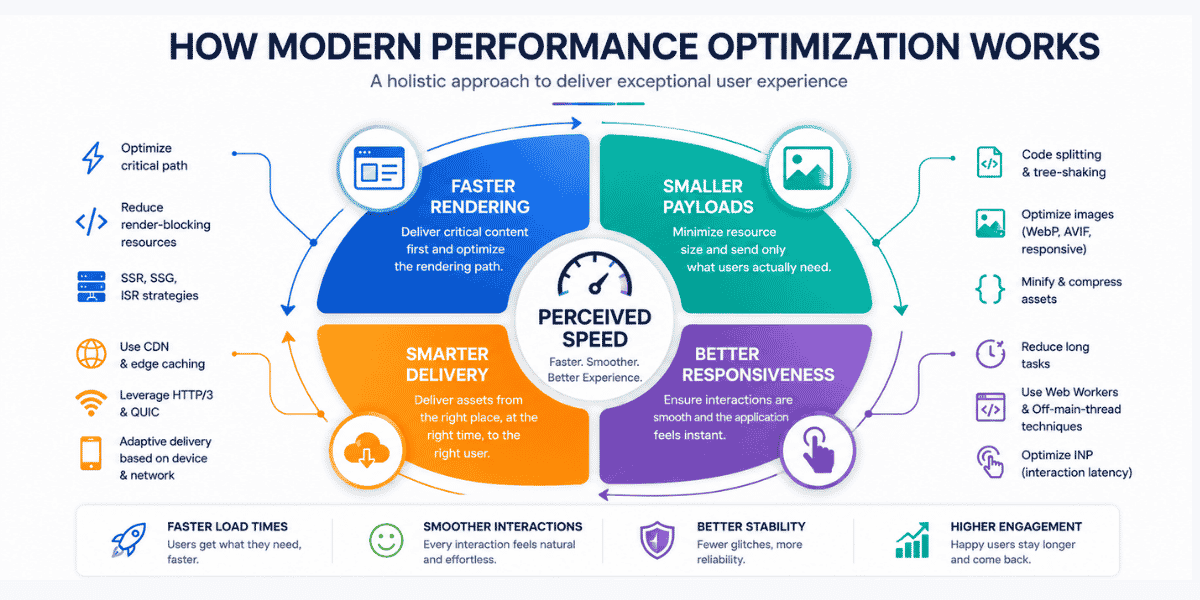

Η απόδοση του frontend το 2026 επικεντρώνεται πλέον στο experience engineering του λογισμικού. Οι εφαρμογές δεν αρκεί μόνο να φορτώνουν γρήγορα· πρέπει επίσης να προσφέρουν μια εμπειρία που να φαίνεται ομαλή, άμεση και αξιόπιστη σε όλη τη διάρκεια της αλληλεπίδρασης του χρήστη.

Τα Google Core Web Vitals παραμένουν ένας από τους σημαντικότερους δείκτες αξιολόγησης της εμπειρίας χρήστη, με ολοένα μεγαλύτερη έμφαση στα πραγματικά δεδομένα χρήσης (real-world user data) και όχι μόνο σε συνθετικά tests εργαστηρίου.

| Μετρική | Τι Μετρά | Ιδανικό Όριο | Βασική Κατεύθυνση Βελτιστοποίησης |

|---|---|---|---|

| Largest Contentful Paint (LCP) | Ταχύτητα φόρτωσης του βασικού περιεχομένου | < 2.5s | Χρήση CDN, βελτιστοποίηση εικόνων, preloading |

| Interaction to Next Paint (INP) | Απόκριση στις αλληλεπιδράσεις του χρήστη | < 200ms | Διαχωρισμός μεγάλων tasks, χρήση web workers |

| Cumulative Layout Shift (CLS) | Οπτική σταθερότητα της σελίδας | < 0.1 | Δέσμευση χώρου για media, σταθερά layouts |

Η αντικατάσταση του First Input Delay (FID) από το INP αντικατοπτρίζει μια σημαντική αλλαγή στη φιλοσοφία του performance optimization. Αντί να μετράται μόνο η πρώτη αλληλεπίδραση του χρήστη, το INP αξιολογεί τη συνολική απόκριση της εφαρμογής σε όλη τη διάρκεια του session, κάτι που το καθιστά πιο κατάλληλο για σύγχρονες single-page εφαρμογές με συνεχή δυναμική αλληλεπίδραση.

Παράλληλα, στρατηγικές rendering όπως το Server-Side Rendering (SSR), το Static Site Generation (SSG) και το Incremental Static Regeneration (ISR) παραμένουν ιδιαίτερα σημαντικές, καθώς επιτρέπουν την ταχύτερη παράδοση του κρίσιμου HTML και βελτιώνουν την αντιλαμβανόμενη ταχύτητα της εφαρμογής. Καθοριστικό ρόλο διαδραματίζει επίσης η βελτιστοποίηση του Critical Rendering Path. Το περιεχόμενο που εμφανίζεται πρώτο στην οθόνη (above-the-fold) πρέπει να φορτώνει κατά προτεραιότητα, ενώ το μη κρίσιμο JavaScript είναι σημαντικό να γίνεται defer ώστε να αποφεύγονται render-blocking καθυστερήσεις. Αντίστοιχα, το CSS πρέπει να οργανώνεται και να φορτώνεται με τρόπο που να μην επιβαρύνει τη διαδικασία rendering.

Εξίσου σημαντικές είναι τεχνικές όπως το code splitting και το tree-shaking. Μέσα από αυτές τις πρακτικές μειώνεται σημαντικά το μέγεθος των JavaScript bundles, καθώς οι χρήστες κατεβάζουν μόνο τον κώδικα που πραγματικά χρειάζονται. Σύγχρονες δυνατότητες CSS, όπως το content-visibility: auto, συμβάλλουν επίσης στη μείωση του rendering workload, καθυστερώντας την επεξεργασία περιεχομένου που βρίσκεται εκτός ορατού πεδίου.

Η βελτιστοποίηση των media παραμένει μία από τις σημαντικότερες προτεραιότητες στο frontend, καθώς εικόνες και βίντεο αντιπροσωπεύουν συχνά το 50–60% του συνολικού βάρους μιας σελίδας. Σύγχρονα formats όπως WebP και AVIF μπορούν να μειώσουν το μέγεθος των εικόνων κατά 25–40%, ενώ τεχνικές responsive delivery μέσω srcset επιτρέπουν την προσαρμογή των assets ανάλογα με τη συσκευή του χρήστη. Παράλληλα, το native lazy loading και ο σαφής ορισμός διαστάσεων για εικόνες και media συμβάλλουν στη διατήρηση υψηλών επιδόσεων στα metrics LCP και CLS.

Throughput και Επεκτασιμότητα του Backend

Η απόδοση του backend καθορίζει κατά πόσο μια εφαρμογή μπορεί να διαχειριστεί υψηλό όγκο κίνησης, να επεξεργαστεί δεδομένα αποδοτικά και να διατηρήσει χαμηλό latency ακόμη και υπό αυξημένη πίεση στην ανάπτυξη ενός λογισμικού. Το 2026, τα backend συστήματα γίνονται ολοένα και πιο κατανεμημένα, cloud-native και modular, με στόχο όχι μόνο την ταχύτητα αλλά και τη μακροχρόνια ανθεκτικότητα και επεκτασιμότητα.

Οι βάσεις δεδομένων παραμένουν συχνά το βασικό bottleneck, καθώς οι disk-based λειτουργίες είναι σημαντικά πιο αργές από την επεξεργασία στη μνήμη. Η αποτελεσματική βελτιστοποίηση ξεκινά από τη σωστή δημιουργία indexes σε συχνά χρησιμοποιούμενα πεδία και από το profiling αργών queries μέσω εργαλείων όπως το MySQL EXPLAIN ή τα profiling εργαλεία της PostgreSQL. Κακές πρακτικές, όπως inefficient joins ή περιττά SELECT * queries, μπορούν να μειώσουν δραματικά το throughput και να αυξήσουν το latency του συστήματος.

Για την καλύτερη κατανομή φορτίου, τεχνικές όπως το database sharding και το partitioning χρησιμοποιούνται όλο και περισσότερο, επιτρέποντας τη διασπορά των δεδομένων σε πολλαπλούς κόμβους ώστε να αποφεύγονται bottlenecks σε μεμονωμένους servers. Παράλληλα, το asynchronous processing αποτελεί πλέον βασική αρχιτεκτονική πρακτική. Βαριές ή χρονοβόρες διεργασίες μεταφέρονται εκτός του κύριου execution thread μέσω task queues όπως RabbitMQ ή Celery, επιτρέποντας στα APIs να απαντούν άμεσα ενώ οι background εργασίες συνεχίζουν ανεξάρτητα.

Η επιλογή τεχνολογίας επηρεάζει επίσης σημαντικά την απόδοση. Η Go χρησιμοποιείται συχνά σε high-throughput APIs χάρη στο lightweight concurrency model και το χαμηλό runtime overhead. Η Python με FastAPI παραμένει ιδιαίτερα σημαντική σε AI και data-intensive εφαρμογές, ενώ το Node.js συνεχίζει να κυριαρχεί σε I/O-heavy real-time συστήματα. Την ίδια στιγμή, η Java με Spring εξακολουθεί να αποτελεί ισχυρή επιλογή για enterprise περιβάλλοντα που απαιτούν σταθερότητα, ωριμότητα και μακροχρόνια υποστήριξη.

Η μετάβαση προς modular αρχιτεκτονικές συμβάλλει επίσης στη μείωση του technical debt. Οι οργανισμοί απομακρύνονται σταδιακά από rigid monolithic συστήματα και στρέφονται σε πιο ευέλικτες και scalable υποδομές που μπορούν να υποστηρίξουν τη συνεχή εξέλιξη και καινοτομία.

Caching, APIs και Data Transfer

Το caching θεωρείται πλέον στρατηγική απαίτηση και όχι απλώς μια backend βελτιστοποίηση στην ανάπτυξη ενός λογισμικού. Η εξυπηρέτηση δεδομένων από τη μνήμη μπορεί να είναι 10–100 φορές ταχύτερη σε σύγκριση με την ανάκτηση δεδομένων από disk-based βάσεις δεδομένων ή εξωτερικά APIs.

| Layer | Τεχνική | Βασικό Όφελος |

|---|---|---|

| Caching | Cache-aside, TTL, refresh-ahead | Ταχύτερη πρόσβαση και μειωμένο φορτίο στη βάση δεδομένων |

| APIs | BFF ή GraphQL | Μείωση over-fetching και βελτιστοποιημένα payloads |

| Transport | HTTP/3 με QUIC | Καλύτερη απόδοση σε ασταθή δίκτυα |

| Serialization | Protobuf, MessagePack | Μικρότερα payloads και ταχύτερο parsing |

| AI Systems | Semantic caching | Έως και 15x ταχύτερες αποκρίσεις |

Διαφορετικές στρατηγικές caching εξυπηρετούν διαφορετικά use cases. Το cache-aside λειτουργεί ιδιαίτερα αποτελεσματικά σε read-heavy συστήματα, ενώ το write-through βελτιώνει τη συνέπεια σε κρίσιμα δεδομένα. Τεχνικές όπως το refresh-ahead συμβάλλουν στη διατήρηση χαμηλού latency σε προβλέψιμα workloads. Παράλληλα, eviction algorithms όπως το Least Recently Used (LRU) και οι πολιτικές TTL βοηθούν στη διατήρηση αποδοτικής χρήσης του cache storage.

Το semantic caching έχει αποκτήσει ιδιαίτερη σημασία στα AI συστήματα. Αντί να βασίζεται αποκλειστικά σε exact matches, χρησιμοποιεί vector embeddings για να αναγνωρίζει αιτήματα με παρόμοιο intent. Με αυτόν τον τρόπο, μπορεί να βελτιώσει τους χρόνους απόκρισης έως και 15 φορές και να μειώσει το κόστος λειτουργίας των LLMs έως και κατά 90%.

Η αρχιτεκτονική των APIs αποτελεί επίσης σημαντικό παράγοντα απόδοσης. Οι Backend for Frontend (BFF) αρχιτεκτονικές δημιουργούν εξειδικευμένα backend layers για διαφορετικούς τύπους clients, όπως mobile ή web εφαρμογές. Αυτό επιτρέπει καλύτερα βελτιστοποιημένα payloads και authentication flows, αν και μπορεί να αυξήσει την επιχειρησιακή πολυπλοκότητα.

Το GraphQL προσφέρει μια διαφορετική προσέγγιση, επιτρέποντας στους clients να ζητούν μόνο τα δεδομένα που πραγματικά χρειάζονται. Σε σύγκριση με το over-fetching των REST-based APIs, το GraphQL μπορεί να μειώσει το μέγεθος των payloads κατά 30–50%, περιορίζοντας παράλληλα τα περιττά network requests.

Τα transport protocols έχουν επίσης εξελιχθεί σημαντικά. Το HTTP/3, βασισμένο στο QUIC, μειώνει το head-of-line blocking αντικαθιστώντας το single TCP stream με ανεξάρτητα UDP-based streams. Σε ασταθή mobile περιβάλλοντα, οι βελτιώσεις απόδοσης μπορούν να ξεπεράσουν το 60% σε σύγκριση με το HTTP/2. Παρ’ όλα αυτά, οι οργανισμοί εξακολουθούν να χρειάζονται αξιόπιστο HTTP/2 fallback, καθώς ορισμένα εταιρικά δίκτυα περιορίζουν την UDP κίνηση.

Η επιλογή serialization format επηρεάζει επίσης σημαντικά την απόδοση. Το JSON παραμένει κυρίαρχο στα public APIs λόγω της αναγνωσιμότητάς του, όμως τα high-throughput συστήματα στρέφονται όλο και περισσότερο σε binary formats όπως MessagePack και Protobuf. Το MessagePack μπορεί να κάνει parsing περίπου 3.5 φορές ταχύτερα από το JSON, ενώ το Protobuf μπορεί να πετύχει 6.5–7.5 φορές ταχύτερο parsing και να μειώσει το μέγεθος των payloads έως και κατά 75%.

AI, Governance και Engineering Culture

Η Τεχνητή Νοημοσύνη έχει πλέον ενσωματωθεί σε ολόκληρο τον κύκλο ζωής ανάπτυξης λογισμικού. AI εργαλεία υποστηρίζουν την αρχιτεκτονική, τον προγραμματισμό, το testing, το deployment, το monitoring και τη συντήρηση συστημάτων. Μπορούν να εντοπίζουν bugs, να δημιουργούν test cases, να ανιχνεύουν bottlenecks και να υποστηρίζουν proactive incident management μέσω AIOps πλατφορμών.

Ωστόσο, ο AI-generated κώδικας εισάγει και νέους κινδύνους. Τα παραγόμενα outputs ενδέχεται να περιλαμβάνουν insecure patterns, hidden bias ή μη αποδοτικές αρχιτεκτονικές αποφάσεις. Για τον λόγο αυτό, οι developers λειτουργούν ολοένα και περισσότερο ως system orchestrators, οι οποίοι αξιολογούν, επιβεβαιώνουν και καθοδηγούν τις AI-generated λύσεις.

Το performance governance γίνεται επίσης πιο οργανωμένο και τυποποιημένο. Οι οργανισμοί χρησιμοποιούν increasingly performance budgets ώστε να αποτρέπουν το feature creep από το να επηρεάζει αρνητικά την εμπειρία χρήστη. Συνηθισμένοι στόχοι για το 2026 περιλαμβάνουν LCP κάτω από 2.5 δευτερόλεπτα, INP κάτω από 200 milliseconds, API response times κάτω από 200 milliseconds και JavaScript bundles μικρότερα από 300KB σε compressed μορφή.

Οι technical managers καλούνται επίσης να εξισορροπήσουν την απόδοση με το κόστος υποδομών. Παρότι το cloud computing προσφέρει υψηλή ευελιξία και scalability, η ανεξέλεγκτη χρήση μπορεί να αυξήσει σημαντικά το operational expenditure. Για αυτόν τον λόγο, πολλοί οργανισμοί υιοθετούν hybrid προσεγγίσεις, διατηρώντας προβλέψιμα workloads on-premise και χρησιμοποιώντας public cloud πλατφόρμες για elastic demand.

Τέλος, η απόδοση εξαρτάται σε μεγάλο βαθμό και από την οργανωσιακή κουλτούρα. Η συνεχής μάθηση, το systems thinking, η συνεργασία και η κοινή ευθύνη για την ποιότητα εξελίσσονται πλέον σε βασικές engineering πρακτικές.

Future Outlook: 2026–2030

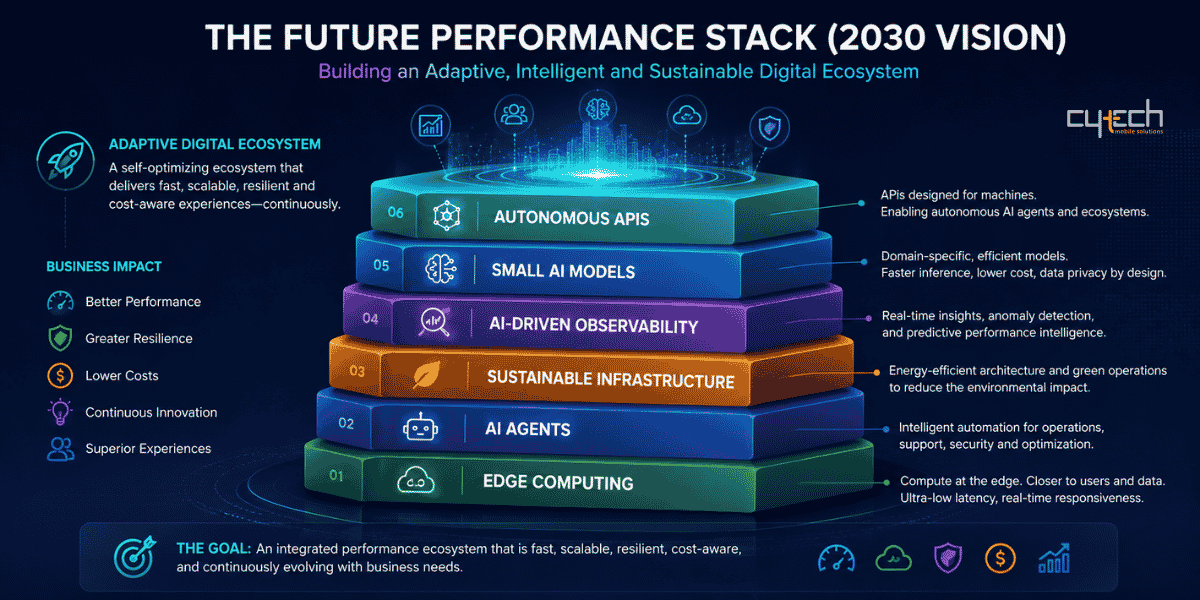

Κοιτώντας προς το 2030, η βελτιστοποίηση της απόδοσης θα επικεντρώνεται ολοένα και περισσότερο σε edge-native computing, sustainable software engineering, AI-driven observability και εξειδικευμένα μικρά AI models. Οι υπολογιστικοί πόροι θα μεταφέρονται πιο κοντά στους χρήστες και στις πηγές δεδομένων, με στόχο τη μείωση του latency και τη βελτίωση του real-time responsiveness. Παράλληλα, τα APIs θα εξελίσσονται ώστε να υποστηρίζουν ολοένα περισσότερο autonomous AI agents και όχι μόνο human-facing εφαρμογές.

Την ίδια στιγμή, το sustainable computing θα αποτελέσει βασική προτεραιότητα, καθώς οι οργανισμοί θα επιδιώκουν να περιορίσουν το ενεργειακό αποτύπωμα των μεγάλων AI workloads. Τα μικρότερα και πιο εξειδικευμένα domain-specific models θα επιτρέπουν επίσης ταχύτερο και πιο localized inference, μειώνοντας ταυτόχρονα το κόστος υποδομών.

Οι οργανισμοί που θα ξεχωρίσουν σε αυτό το περιβάλλον θα είναι εκείνοι που θα συνδυάζουν modular αρχιτεκτονικές, cloud-native υποδομές, πειθαρχημένο performance governance, AI-driven λειτουργίες και ισχυρή engineering κουλτούρα. Το μέλλον της απόδοσης λογισμικού δεν αφορά πλέον τη βελτιστοποίηση μεμονωμένων components. Αφορά τη δημιουργία ενός ενιαίου ψηφιακού συνεχούς που θα είναι γρήγορο, scalable, ανθεκτικό, cost-aware και ικανό να εξελίσσεται διαρκώς μαζί με τις ανάγκες της επιχείρησης.

Βιβλιογραφία

- HTTP/1.1 vs HTTP/2 vs HTTP/3 – Which One Are You Still Using in 2025?

- Caching Strategies To Improve Operational Performance And Cost Efficiency In Modern Computing Systems

- Frontend vs Backend vs Full-Stack: What’s Changing in 2026?

- Core Web Vitals in 2025: What Has Changed and What’s New

- What Is Real User Monitoring (RUM)? The 2026 Guide

- The Ultimate Frontend Performance Checklist for Modern Websites

- How AI Is Transforming the Software Development Lifecycle (SDLC)

- The Complete Frontend Performance Checklist for Developers

- An Expert’s Guide To Best Frontend Performance Best Practices

- Backend Performance Tuning: Techniques and Tools

- The complete guide to cache optimization strategies for developers

- Caching Strategies Across Application Layers: Building Faster, More Scalable Products

- Comprehensive comparison for Backend technology in applications

- How to Future-Proof Your Tech Stack for 2025 and Beyond

- Caching Strategies Explained: The Complete Guide

- BFF vs Aggregation Layer: Choosing the Right API Gateway Pattern for Modern Microservices

- GraphQL vs. REST at enterprise scale: Performance benchmarks

- HTTP/3 and QUIC in Production: A Practical Deployment Guide for 2026

- HTTP/3 for Microservices in 2025: QUIC, gRPC over h3, 0‑RTT Risks, and a Safe Migration Playbook

- JSON vs Protocol Buffers: Speed, Size, and Schema Tradeoffs

- Redis Serialization Best Practices (JSON vs MessagePack vs Protobuf)

- JSON vs MessagePack vs Protobuf in Go — My Real Benchmarks and What They Mean in Production

- 2025 Trends in Full Stack Development: Innovation Meets Agility

- 2025 Developer Survey

- AIOps in 2026, and beyond: Top 11 Use Cases, Examples, and Emerging Trends

- AIOps Software Options 2026

- Top 10 AIOps Platforms 2026: AI-Powered Observability

- IT Budget Planning 2026: How Tech Leaders Can Win in an Uncertain Year

- 2026 Business Technology Budgeting Guide

- The Strategic IT Budgeting Guide for 2026: Cut Waste, Increase Value, Plan with Confidence

- From check-ins to coaching: What performance management will look like in 2026

- 13 Practical Performance Management Strategies To Implement (In 2026)